CUDA (Compute Unified Device Architecture) – технология, разработанная компанией NVIDIA, позволяющая использовать графические процессоры (GPU) для выполнения вычислений общего назначения. CUDA ядра предоставляют возможность ускоренного параллельного программирования, открывая новые горизонты в области вычислительной мощности.

Одно из главных достоинств CUDA ядер – их способность вычислять несколько задач одновременно, благодаря параллельной обработке операций. Графические процессоры обладают огромным количеством ядер, которые могут эффективно выполнять сотни или даже тысячи параллельных заданий. Таким образом, использование CUDA ядер позволяет значительно ускорить вычисления в таких областях, как научные исследования, машинное обучение, обработка изображений и видео.

Работа с CUDA ядрами осуществляется с помощью специального программного интерфейса – CUDA Toolkit. Он предоставляет разработчикам не только набор инструментов для программирования на языке CUDA C++, но и возможность использовать CUDA в других языках программирования, таких как Python, Java и MATLAB.

Основной принцип работы CUDA ядер заключается в распределении задач между множеством ядер GPU. Каждое ядро выполняет свою часть кода независимо от других ядер, что позволяет достичь максимальной параллельности и эффективности вычислений. Благодаря этому, программа, использующая CUDA ядра, может выполнять задачи гораздо быстрее, чем при использовании только центрального процессора компьютера.

Видео:КАК работает ВИДЕОКАРТА? ОБЪЯСНЯЕМСкачать

Описание CUDA ядер

В отличие от центрального процессора (CPU), графический процессор (GPU) имеет значительно большее количество ядер и специализирован для обработки графики и параллельных вычислений. CUDA ядра позволяют использовать вычислительную мощность графического процессора для решения ряда задач общего назначения.

Каждое CUDA ядро представляет собой функцию, которая может быть вызвана и выполняться параллельно на множестве ядер графического процессора. Они разделяют нагрузку и обрабатывают разные части данных одновременно, что приводит к значительному ускорению вычислений по сравнению с использованием только центрального процессора.

Ключевой особенностью CUDA ядер является возможность программирования с использованием языка программирования высокого уровня, такого как С/С++, а также использование специальных библиотек и инструментов разработки.

Применение CUDA ядер широко распространено в области научных и инженерных расчетов, машинного обучения, глубокого обучения, компьютерного зрения и других областях, где требуются высокопроизводительные вычисления и обработка больших объемов данных.

Основные характеристики CUDA ядер

1. Параллельность

Одна из главных особенностей CUDA ядер — возможность выполнять вычисления параллельно. Благодаря использованию графических процессоров, которые содержат большое количество ядер, CUDA позволяет выполнить множество вычислительных задач одновременно. Это значительно ускоряет процесс и позволяет достичь высокой производительности.

2. Гибкость задач

Каждое CUDA ядро может выполнять различные вычислительные задачи, а не только задачи, связанные с графической обработкой. Это позволяет использовать CUDA для решения широкого спектра задач, таких как научные вычисления, анализ данных, вычислительная биология и другие.

3. Эффективность

CUDA ядра предоставляют прямой доступ к аппаратуре графического процессора, что делает вычисления более эффективными. Они могут использовать специализированные операции и память GPU, что позволяет достичь высокой производительности в задачах высокой интенсивности вычислений.

4. Простота программирования

CUDA ядра предоставляют простой и удобный интерфейс для программирования графического процессора. Они используют язык программирования CUDA, который основан на языке Си. Это позволяет разработчикам легко создавать и оптимизировать параллельные вычисления для графического процессора.

5. Масштабируемость

CUDA ядра обладают высокой масштабируемостью, что позволяет использовать несколько графических процессоров одновременно для выполнения вычислительных задач. Это значительно повышает общую производительность системы и позволяет решать более сложные задачи.

Примеры использования CUDA ядер в практике

CUDA ядра имеют широкий спектр применений и используются в различных областях. Они позволяют значительно ускорить вычисления на графических процессорах, что делает их незаменимыми в таких сферах, как:

1. Научные исследования: CUDA ядра находят применение в различных научных областях, таких как физика, химия, биология и многих других. Они позволяют обрабатывать и анализировать большие объемы данных в реальном времени, ускоряя процесс исследования и делая его более эффективным.

2. Графика и визуализация: CUDA ядра используются в разработке игр, 3D моделировании и визуализации. Они позволяют создавать реалистичные и детализированные графические сцены, обрабатывать графические эффекты и ускорять работу с большими объемами данных.

3. Машинное обучение и искусственный интеллект: CUDA ядра позволяют эффективно обрабатывать и анализировать данные в машинном обучении и искусственном интеллекте. Они используются для ускорения процесса обучения моделей, классификации данных и анализа больших наборов информации.

4. Финансовые вычисления: В финансовой сфере CUDA ядра применяются для анализа рынка, риск-менеджмента, оптимизации портфелей и других задач. Они позволяют обрабатывать огромные объемы финансовой информации в реальном времени, что способствует принятию более точных и обоснованных решений.

5. Медицинские исследования: CUDA ядра применяются в обработке и анализе медицинских данных, таких как снимки, последовательности ДНК и другие. Они позволяют быстро обрабатывать и анализировать огромные объемы информации, что помогает исследователям и врачам принимать решения на основе точной и актуальной информации.

6. Криптография и безопасность: CUDA ядра используются в задачах шифрования, аутентификации и анализа безопасности данных. Они позволяют проводить высокопроизводительные вычисления, необходимые для обработки и защиты конфиденциальной информации.

Это лишь некоторые примеры использования CUDA ядер в практике. Благодаря своей высокой производительности и гибкости, они находят применение во многих других областях, где требуется обработка больших объемов данных и ускорение вычислений.

Видео:Устройство ядра Turing / GeForce RTX и новые технологии для геймеров и разработчиковСкачать

Принцип работы CUDA ядер

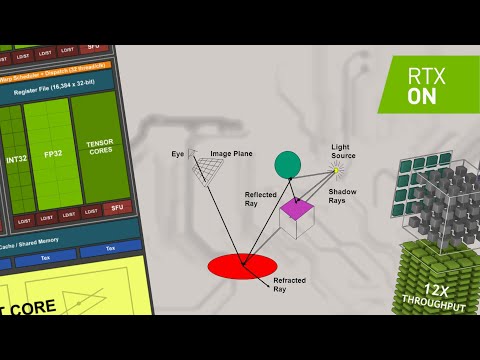

Каждый поток выполняет одинаковую операцию на разных данных, что позволяет графическому процессору выполнять их параллельно и сократить время выполнения задачи. Каждое ядро графического процессора может выполнять одновременно множество потоков.

Для запуска CUDA ядра необходимо создать сетку потоков, которая представляет собой трехмерную структуру размещения потоков. Каждый поток имеет свои координаты в этой трехмерной сетке, которые используются для доступа к вычисляемым данным.

После запуска ядра, каждый поток выполняет свою задачу независимо от других потоков. В процессе выполнения задачи, потоки синхронизируются и обмениваются данными с помощью разделяемой памяти, что позволяет им совместно решать сложные задачи.

Принцип работы CUDA ядер основан на мощности и параллельности графического процессора, что позволяет достичь высокой производительности при обработке данных. Вместо последовательной обработки каждого элемента задачи, CUDA ядра выполняют параллельную обработку множества элементов этой задачи. Это позволяет ускорить выполнение вычислений и решать более сложные задачи в сравнении с обычными центральными процессорами.

Программная модель работы CUDA ядер

Программная модель работы CUDA ядер предоставляет разработчикам возможность параллельно выполнять вычисления на графическом процессоре. Для этого разработчик описывает функцию, которая будет выполняться на каждом ядре, исключительно на графическом процессоре, используя специальные инструкции и операции.

Каждое ядро выполняется независимо от других ядер и имеет свое уникальное идентификатором, известное как threadIdx. Все ядра объединяются в блоки (blocks), которые в свою очередь объединяются в сетки (grids). Используя индексы ядер и блоков, разработчик может организовать параллельные вычисления и передачу данных между ядрами.

В программной модели работы CUDA ядер существуют и другие важные концепции. Например, базовая функция, которая описывает выполнение всех ядер внутри блока, называется ядром (kernel). Блоки, которые объединяют ядра, могут быть организованы в трехмерную структуру, позволяя более гибко управлять параллельными вычислениями. Также, в программной модели CUDA ядер предусмотрены специальные объекты, такие как разделяемая память, управление потоками и синхронизация.

Программная модель работы CUDA ядер позволяет разработчикам создавать мощные параллельные программы, которые выполняются на графическом процессоре. Это особенно полезно для задач, которые требуют высокой производительности и интенсивных вычислений, таких как научные исследования, симуляции физических процессов и обработка больших объемов данных.

Аппаратная архитектура CUDA ядер

CUDA ядра — это маленькие вычислительные блоки, которые выполняются на графическом процессоре. Они состоят из множества вычислительных ядер, которые работают параллельно и могут выполнять большое количество операций одновременно. Каждое ядро имеет доступ к своей собственной памяти и может выполнять инструкции независимо от других ядер.

Аппаратная архитектура CUDA ядер включает в себя следующие компоненты:

- Множество вычислительных ядер: CUDA ядра содержат множество вычислительных ядер, которые работают параллельно и выполняют вычисления. Количество ядер может варьироваться в зависимости от модели графического процессора.

- Универсальные функциональные блоки (SM): Универсальные функциональные блоки — это сегменты аппаратуры, которые содержат несколько вычислительных ядер и память разделяемого доступа. Они работают независимо друг от друга и могут выполнять различные задачи одновременно.

- Память разделяемого доступа (shared memory): Память разделяемого доступа — это память, которой могут пользоваться все вычислительные ядра внутри одного универсального функционального блока. Она используется для обмена данными между ядрами и ускоряет их выполнение.

- Глобальная память: Глобальная память — это память, доступная для всех ядер на графическом процессоре. Она используется для хранения данных, которые используются во всей программе.

- Текстурная память: Текстурная память — это специальный тип памяти, который позволяет быстро получать данные для текстурных операций, таких как чтение изображений или сэмплирование текстур. Она обеспечивает повышенную производительность при работе с графическими данными.

- Кэш констант: Кэш констант — это специальный тип памяти, который используется для хранения постоянных данных, таких как константы или таблицы. Он обеспечивает быстрый доступ к этим данным и повышает производительность при их использовании.

Аппаратная архитектура CUDA ядер позволяет эффективно выполнять параллельные вычисления на графическом процессоре. Она обеспечивает высокую производительность и энергоэффективность при выполнении различных видов задач. Благодаря этой архитектуре, CUDA ядра стали популярным инструментом для реализации высокопроизводительных вычислений в различных областях, таких как научные исследования, машинное обучение и обработка видео.

🔍 Видео

Всё о видеокартах за 11 минутСкачать

CUDA и cuDNN - КАК СКАЧАТЬ, УСТАНОВИТЬ И ПРОВЕРИТЬСкачать

Распределённые и параллельные вычисления 3. CUDA. ВведениеСкачать

Технология CUDA от NVIDIA GEFORCE.Как включить в AFTER EFFECTS И PREMIER PROСкачать

CUDA деваются ядра CUDA!? Выбор оптимальной видеокарты для работы.Скачать

Связаны ли частоты CUDA, RT и тензорных ядер в RTX картах?Скачать

Nvidia CUDA. Эволюция GPU. Краткий экскурс.Скачать

Принцип работы процессора на уровне ядраСкачать

Новые видеокарты Nvidia пугают количеством ядер CUDAСкачать

Nvidia CUDA С++. Сравнение скорости вычислений с CPUСкачать

GPU ускорение в After Effects (CUDA и OpenGL). Миф или реальность? - AEplug 070Скачать

Nvidia CUDA С Уроки. Определение характеристик устройств. Параллельное программирование GPU.Скачать

CUDA 2022Скачать

OpenCL vs Cuda Rendering (GTX 650 vs 7770, FX 6300)Скачать

Работа видеокарты и процессора в AdobePremiere CUDA NvidiaСкачать

Преимущество технологии CUDA !!! Краткий обзор видеоконвертеров ...Скачать