Мультиколлинеарность – это статистическое явление, которое возникает, когда две или более независимых переменных в модели линейной регрессии сильно коррелируют друг с другом. Такая корреляция может вызывать проблемы при анализе и интерпретации результатов, а также приводить к неустойчивости модели.

Одной из причин мультиколлинеарности является неправильный выбор переменных для моделирования. Если в модели присутствуют переменные, которые очень похожи и сильно коррелируют друг с другом, то это может привести к мультиколлинеарности. Также мультиколлинеарность может возникнуть, если в модели присутствуют переменные, которые являются линейной комбинацией друг друга.

Мультиколлинеарность может создавать проблемы при интерпретации коэффициентов модели. Когда переменные сильно коррелируют, их эффект на зависимую переменную становится трудно отделить друг от друга. Это означает, что изменение одной переменной может вызывать изменение другой переменной, что затрудняет понимание и изучение влияния каждой переменной на модель. Более того, мультиколлинеарность может приводить к неустойчивому поведению коэффициентов, что делает модель неадекватной и непригодной для использования в предсказаниях.

Видео:Множественная регрессия в Excel и мультиколлинеарностьСкачать

Мультиколлинеарность: определение, сущность, значение

Сущность мультиколлинеарности состоит в том, что она затрудняет определение точной роли каждой из независимых переменных в модели. Если две или больше переменных сильно коррелируют между собой, то нельзя однозначно сказать, какая именно переменная вносит больший вклад в объяснение зависимой переменной. Это может затруднить интерпретацию результатов модели и делать их менее надежными.

Поэтому важно учитывать мультиколлинеарность при проведении регрессионного анализа и принимать необходимые меры для ее устранения. Существуют различные методы, такие как удаление одной из коррелирующих переменных, использование методов регуляризации или использование других моделей, которые позволяют справиться с проблемой мультиколлинеарности и получить более надежные результаты.

Видео:Определение мультиколлинеарностиСкачать

Понятие мультиколлинеарности

Мультиколлинеарность может возникать по разным причинам. Одной из причин является наличие линейной зависимости между предикторами. Это означает, что один предиктор может быть точно предсказан на основе других предикторов. Также мультиколлинеарность может возникать из-за ошибок в данных, например, при повторном включении одного и того же предиктора или измерения.

Важно понять и осознать наличие мультиколлинеарности, так как она может привести к серьезным проблемам при интерпретации результатов регрессионного анализа. Например, коэффициенты регрессии могут быть неправильно оценены, их значимость может быть недостоверной, а предсказательная способность модели может быть снижена.

Для решения проблемы мультиколлинеарности существуют различные методы. Одним из способов является удаление одного из связанных предикторов, если их зависимость слишком высока. Другим методом является сокращение размерности данных путем факторного анализа или применения методов регуляризации, таких как гребневая регрессия или лассо.

Важно учитывать мультиколлинеарность при проведении регрессионного анализа, чтобы получить надежные и интерпретируемые результаты. Это поможет избежать проблем, связанных с зависимостью между предикторами и улучшить качество модели.

Определение мультиколлинеарности

Мультиколлинеарность может быть проблемой, потому что она искажает результаты статистического анализа и делает интерпретацию данных затруднительной. Например, когда две переменные сильно коррелируют, может возникнуть проблема мультиколлинеарности, поскольку невозможно определить, какая из переменных больше влияет на зависимую переменную.

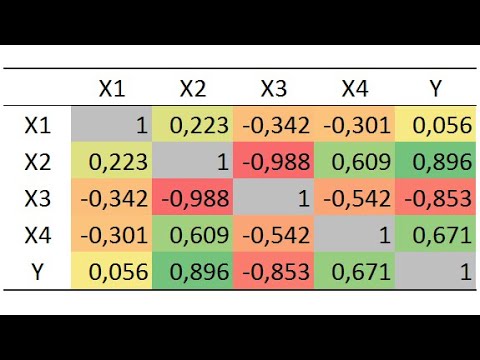

Мультиколлинеарность может быть обнаружена с помощью различных статистических методов, таких как множественная регрессия или корреляционный анализ. Когда мультиколлинеарность обнаружена, ее можно решить путем удаления одной или нескольких переменных, объединения коррелирующих переменных или использования других статистических методов для повышения точности анализа.

Важность понимания мультиколлинеарности

Мультиколлинеарность представляет собой серьезную проблему в анализе данных, которая возникает, когда в регрессионной модели существует высокая корреляция между независимыми переменными. Это может привести к нескольким негативным последствиям, которые не только усложняют интерпретацию результатов, но и могут существенно исказить предсказания модели.

Одной из основных причин возникновения мультиколлинеарности является наличие линейной зависимости между независимыми переменными. Это означает, что одна независимая переменная может быть линейно предсказана на основе другой независимой переменной или их комбинации. Подобное явление может испортить оценки коэффициентов регрессии и сделать их недостоверными.

Кроме того, мультиколлинеарность может привести к нестабильным оценкам коэффициентов. Если переменные в модели сильно коррелированы между собой, то малейшие изменения в данных могут привести к радикально разным оценкам коэффициентов. Это делает модель неустойчивой и неадекватной для прогнозирования.

Еще одним негативным последствием мультиколлинеарности является затруднение интерпретации результатов модели. Когда переменные сильно коррелированы, становится сложно определить вклад каждой из них в объяснение зависимой переменной. Коэффициенты регрессии теряют ясность и понятность, что делает интерпретацию результатов затруднительной.

| Проблемы, вызванные мультиколлинеарностью: | Возможные последствия: |

|---|---|

| Недостоверные оценки коэффициентов | |

| Неустойчивость оценок коэффициентов | Невозможность повторного воспроизведения результатов |

| Затруднение интерпретации результатов | Ошибки в принятии решений на основе модели |

Для борьбы с мультиколлинеарностью существуют различные подходы и методы. Одним из них является снижение размерности данных путем исключения лишних переменных или их преобразования. Также можно использовать методы регуляризации, например, Ridge и Lasso регрессию, которые штрафуют большие коэффициенты и позволяют сократить мультиколлинеарность.

В целом, понимание мультиколлинеарности и ее влияния на результаты анализа данных крайне важно для исследователей и аналитиков. Это позволяет избежать ошибок в интерпретации и принятии решений на основе модели. Также это позволяет применять соответствующие методы борьбы с мультиколлинеарностью и повысить качество анализа данных и предсказательных моделей.

Видео:МультиколлинеарностьСкачать

Причины возникновения мультиколлинеарности

Существуют как математические, так и статистические причины возникновения мультиколлинеарности. Математические причины связаны с особенностями данных и методами их анализа, а статистические причины связаны с несоответствиями между выборкой и генеральной совокупностью.

- Математические причины мультиколлинеарности:

- Существует линейная связь между двумя или более предикторами. Например, предикторы могут быть измерены в одной шкале или быть линейной комбинацией друг друга. Это может привести к сильной корреляции между ними.

- Есть ошибка в измерении предикторов. Например, при измерении двух предикторов могут быть допущены ошибки, и это может вызвать их взаимосвязь в модели.

- Присутствуют круговые зависимости. Если предикторы взаимозависимы и образуют цикл в модели, то это может привести к мультиколлинеарности.

- Статистические причины мультиколлинеарности:

- Неоднородность выборки. Если выборка содержит слишком мало наблюдений или пропуски данных, это может привести к мультиколлинеарности.

- Неслучайная выборка. Если выборка неслучайно отобрана из генеральной совокупности, то это может привести к мультиколлинеарности.

- Неправильное моделирование. Если модель неправильно специфицирована, то это может привести к мультиколлинеарности. Например, если был пропущен важный предиктор или неправильно выбрана функциональная форма модели.

Понимание причин возникновения мультиколлинеарности очень важно для решения этой проблемы. Путем изучения и анализа причин можно предпринять соответствующие шаги для решения проблемы мультиколлинеарности, такие как удаление коррелирующих предикторов или преобразование данных.

Математические причины мультиколлинеарности

Матричный подход при решении задач регрессионного анализа позволяет выявить наличие мультиколлинеарности. Если матрица данных имеет высокую обусловленность, то это свидетельствует о существовании мультиколлинеарности.

Существует несколько способов обнаружения мультиколлинеарности на основе матричного анализа. Например, можно рассчитать числовые значения, такие как коэффициент обусловленности и числовой показатель Винера, которые позволят определить степень мультиколлинеарности в модели.

| Признак | Независимый переменный 1 | Независимый переменный 2 | Зависимый переменный |

|---|---|---|---|

| 1 | 1 | 2 | 3 |

| 2 | 2 | 4 | 6 |

| 3 | 3 | 6 | 9 |

| 4 | 4 | 8 | 12 |

Рассмотрим следующую таблицу с данными в качестве примера. Заметим, что значения в столбце «Независимый переменный 2» являются удвоенными значениями в столбце «Независимый переменный 1». Такая линейная зависимость может привести к мультиколлинеарности и искажению результатов анализа.

Чтобы избежать мультиколлинеарности, необходимо проанализировать и выбрать наиболее значимые переменные для модели. Также можно провести преобразование данных, например, путем центрирования и шкалирования переменных, что поможет снизить влияние мультиколлинеарности.

Статистические причины мультиколлинеарности

Статистические причины мультиколлинеарности могут быть связаны с различными факторами:

1. Высокая корреляция между предикторами:

Когда у предикторов существует сильная положительная или отрицательная корреляция между собой, это может вызвать мультиколлинеарность. Например, если в модели присутствуют две переменные, измеряющие одинаковую характеристику, например, вес и рост человека, то они могут быть сильно коррелированы между собой.

2. Слишком маленькая выборка:

Если размер выборки недостаточно большой, то статистические методы могут не учесть маленькие отличия между предикторами и ошибочно считать их сильно коррелированными. Это может привести к ложной мультиколлинеарности.

3. Выбросы или ошибки измерения:

Наличие выбросов или ошибок измерения в данных может привести к искажению статистических характеристик и создать иллюзию мультиколлинеарности. Например, если в данных есть выбросы, которые сильно влияют на результаты регрессии, то это может привести к высокой корреляции между предикторами, даже если на самом деле они не коррелируют.

В целом, статистическая мультиколлинеарность может быть вызвана различными причинами, и ее влияние на результаты регрессионной модели может быть значительным. Поэтому важно быть осторожным и учитывать возможность мультиколлинеарности при анализе данных и построении регрессионных моделей.

🎥 Видео

Линейная зависимость и линейная независимость векторов.Скачать

Мультиколлинеарность. Алгоритм Фаррара-Глобера. Эконометрика. Регрессия. Multicollinearity.Скачать

Линейная зависимость и линейная независимость. ТемаСкачать

Множественная регрессия в ExcelСкачать

Корреляционно-регрессионный анализ многомерных данных в ExcelСкачать

Что такое линейная регрессия? Душкин объяснитСкачать

Множественная регрессияСкачать

Математика #1 | Корреляция и регрессияСкачать

Метод наименьших квадратов. Линейная аппроксимацияСкачать

Примеры линейной зависимости векторов.Скачать

РЕГРЕССИОННЫЙ АНАЛИЗ STATISTICA #12Скачать

Линейная регрессия. Что спросят на собеседовании? ч.1Скачать

РЕАЛИЗАЦИЯ ЛИНЕЙНОЙ РЕГРЕССИИ | Линейная регрессия | LinearRegression | МАШИННОЕ ОБУЧЕНИЕСкачать

Линейная зависимость векторов на примерахСкачать

Наличие мультиколлинеарностиСкачать

Линейная комбинация. Линейная зависимость (независимость) матриц.Скачать

Лекция 2.1: Линейная регрессия.Скачать